À l'occasion de la Journée mondiale du mot de passe, une étude révèle que les mots de passe générés par ChatGPT, Llama ou DeepSeek présentent des failles critiques. Les cybercriminels peuvent les craquer en un temps record.

- Une étude révèle que les mots de passe générés par l'IA, comme ChatGPT, ne sont pas aussi sécurisés qu'espéré.

- Des chercheurs ont découvert que même si les IA suivent certaines règles de création, des patterns récurrents les rendent vulnérables aux attaques.

- Ces faiblesses permettent aux hackers chevronnés d'exploiter ces mots de passe parfois en moins d'une heure.

La ruée vers l'IA pour sécuriser nos comptes en ligne pourrait bien être notre talon d'Achille. Une étude de Kaspersky publiée ce mercredi 30 avril démontre que les mots de passe générés par les grands modèles de langage comme ChatGPT présentent des schémas récurrents. Ils offrent aux cybercriminels presque sur un plateau une porte dérobée vers nos données personnelles. Entre fausse sécurité et vulnérabilités réelles, l'intelligence artificielle n'est pas la panacée espérée.

Les schémas répétitifs qui trahissent vos mots de passe IA

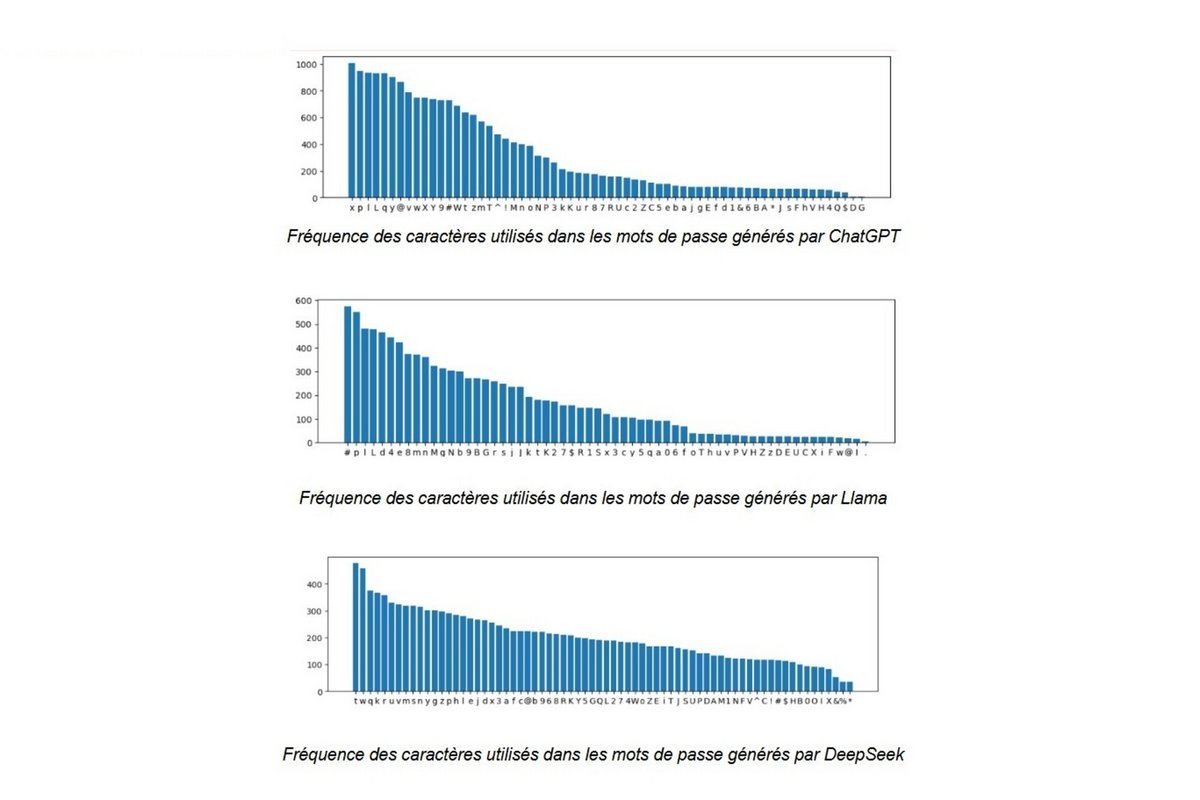

Alexey Antonov, chef de l'équipe Data Science chez Kaspersky, a mis les intelligences artificielles à l'épreuve en générant 1 000 mots de passe via ChatGPT, Llama et DeepSeek. Le résultat est sans appel : bien que ces systèmes connaissent les règles de création d'un bon mot de passe, soit un minimum de 12 caractères et un mélange de majuscules, minuscules, chiffres et symboles, ils échouent dans leur application.

« DeepSeek et Llama ont parfois généré des mots de passe composés de mots du dictionnaire, dans lesquels certaines lettres sont remplacées par des chiffres de forme similaire : S@d0w12, M@n@go3, B@n@n@7 (DeepSeek), K5yB0a8dS8, S1mP1eL1on (Llama) », explique Antonov. Plus inquiétant encore, ces deux modèles ont tendance à générer des variations du mot « password », comme par exemple « P@ssw0rd, P@ssw0rd!23 (DeepSeek), P@ssw0rd1, P@ssw0rdV (Llama) ».

ChatGPT évite le piège des mots du dictionnaire et génère des chaînes qui semblent aléatoires comme « qLUx@^9Wp#YZ » ou « LU#@^9WpYqxZ ». Mais en analysant attentivement ces créations, les experts ont découvert des motifs récurrents.

Le chiffre 9 apparaît systématiquement, tandis que certains symboles (x, p, l, L) sont surreprésentés, contredisant l'aspect aléatoire essentiel à un mot de passe en théorie sécurisé. Ce qui est préoccupant ici, c'est que 26% des mots de passe générés par ChatGPT ne contiennent ni caractère spécial ni chiffre, contre 32% pour Llama et 29% pour DeepSeek.

Des failles exploitées en moins d'une heure par les cybercriminels

Alexey Antonov a conçu un algorithme l'an dernier pour tester la robustesse des mots de passe. Après ses tests, le spécialiste en cybersécurité conclut que 60% des mots de passe standards peuvent être déchiffrés en moins d'une heure grâce aux processeurs graphiques modernes, ou aux outils basés sur le cloud que certains hackers peuvent aussi utiliser.

DeepSeek et Llama ont également tendance à ignorer leurs propres règles, en générant parfois des mots de passe de moins de 12 caractères, bien en-deçà des standards de sécurité qu'ils préconisent eux-mêmes. En connaissant ces corrélations et ces faiblesses, les cybercriminels pourraient et peuvent accélérer considérablement leurs attaques par force brute, en ciblant d'abord les combinaisons les plus fréquentes.

Appliqué aux créations de l'IA, le constat n'est pas plus rassurant. 88% des mots de passe générés par DeepSeek et 87% par Llama sont vulnérables aux attaques sophistiquées. ChatGPT s'en sort mieux, mais 33 % de ses propositions restent compromises. « Le problème, c'est que les LLM ne génèrent rien véritablement au hasard. Ils imitent des modèles de données existantes, ce qui rend leurs résultats prévisibles pour les attaquants », commente Antonov.

La solution réside sans doute dans l'adoption de gestionnaires de mots de passe spécialisés. Ces outils utilisent des générateurs cryptographiquement sécurisés, qui garantissent l'aspect aléatoire, stockent vos informations dans un coffre-fort numérique protégé par un unique mot de passe maître, et offrent des fonctionnalités pratiques comme le remplissage automatique. À l'heure où les violations de données sont monnaie courante, chaque compte mérite un rempart infranchissable.

29 avril 2025 à 16h34